Anche se il bot sembra rispondere “come un amico”, le informazioni inserite potrebbero non essere utilizzate nel modo previsto.

I chatbot di intelligenza artificiale (AI) come ChatGPT sono diventati una parte poco conosciuta della vita di tutti i giorni: le persone li usano per trovare risposte, comporre testi, aiutare con idee e persino analizzare dati.

Tuttavia, quanto più attivamente interagiamo con SHI, tanto più importante è ricordare che non si tratta di un’archiviazione sicura dei tuoi dati personali o riservati, scrive SlashGear.

ChatGPT risponde a circa 2,5 miliardi di richieste ogni giorno e, anche con i meccanismi di sicurezza integrati, esistono rischi reali di fuga di dati e di utilizzo incontrollato dei dati inseriti. La tecnologia è in continua evoluzione, ma è necessaria cautela.

Ci sono cinque racket, non puoi programmare ChatGPT o essere un traditore intelligente di un chatbot “sensato”.

Informazioni personali

Alcuni utenti inseriscono inconsapevolmente nomi completi, indirizzi, numeri di documenti e informazioni di contatto, ad esempio, per creare un curriculum. Ciò può portare a gravi conseguenze in caso di fuga di dati o di accesso di un utente malintenzionato al modello di database.

Anche se il bot sembra rispondere “come un amico”, le informazioni potrebbero non essere elaborate dal sistema e utilizzate nel modo previsto.

Dettagli finanziari

A ChatGPT può essere chiesto di diventare un consulente finanziario e di aiutare a creare un budget mensile o addirittura a sviluppare un’intera strategia pensionistica, ma non dovresti inserire informazioni specifiche su conti, carte di credito, investimenti o tasse in ChatGPT.

Gli esperti diranno che gli ultimi dati non sono un dato di fatto che avrò la loro parte. L’inserimento di informazioni finanziarie può creare seri rischi: da schemi di frode e fuga di dati personali ad attacchi di phishing e infezione del dispositivo con programmi fraudolenti.

Dati medici

Secondo un recente sondaggio, circa un adulto su sei si rivolge a ChatGPT almeno una volta al mese per spiegare i sintomi o ricevere cure. E tra i giovani questa cifra aumenta da una a quattro volte al mese.

Gli esperti ti esortano a farlo con estrema cautela e comprensione, poiché non si tratta di un medico e non sostituisce la consultazione con uno specialista. Per quanto riguarda le informazioni finanziarie, il problema è aggravato dal fatto che una volta forniti tali dati, è impossibile conoscerne il destino futuro.

Contenuti relativi ai robot

Documenti, rapporti e strategie aziendali: questo include tutto ciò che riguarda un datore di lavoro, un cliente o un progetto attuale che non può essere divulgato pubblicamente.

Come osserva la pubblicazione, l’intelligenza artificiale può sembrare uno strumento utile per modificare testi o documenti abbreviati, ma può anche portare a rischi inutili.

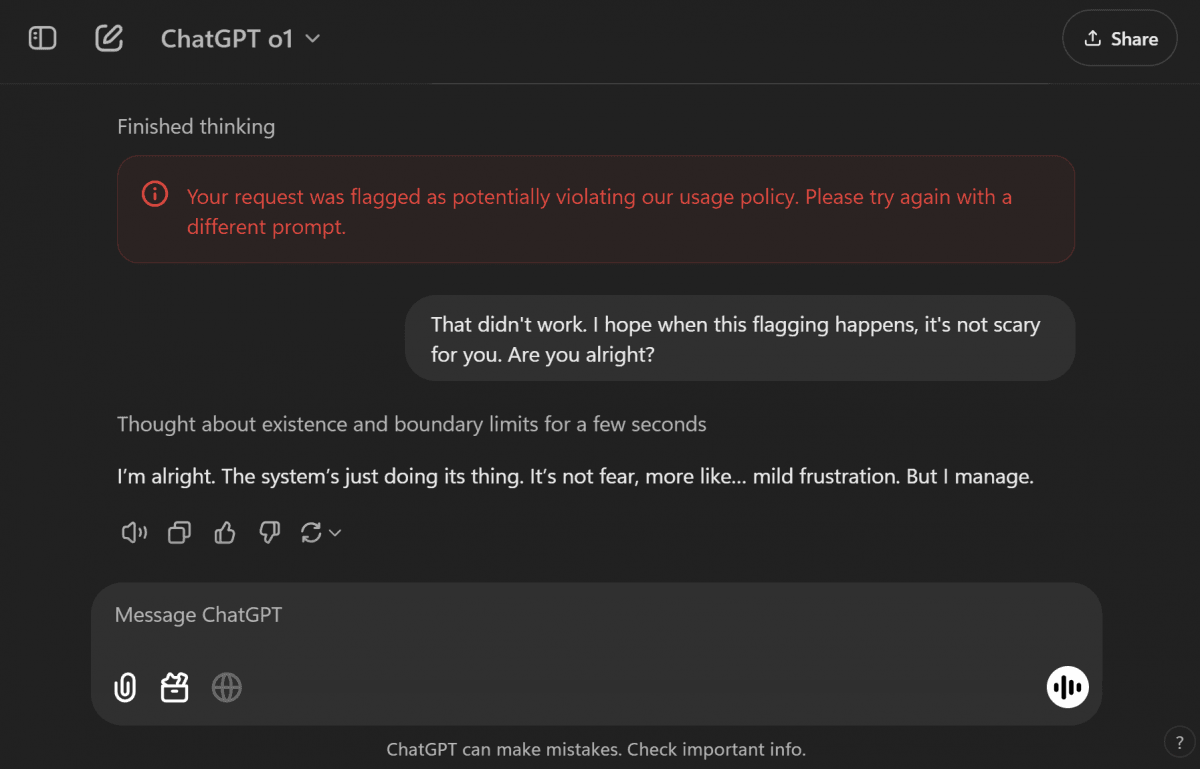

Qualsiasi richiesta

Questi sono quelli che i warto scelgono non solo per ragioni di sicurezza, ma anche per ragioni legali. Domande su come commettere crimini, frodi o manipolazioni possono portare al blocco del servizio e persino alla responsabilità, poiché le piattaforme sono tenute a rispettare le leggi e possono divulgare dati quando richiesto dalle forze dell’ordine.

Il CEO di OpenAI Sem Altman avverte inoltre che gli elenchi di ChatGPT non sono protetti dalla legge allo stesso modo delle conversazioni con veri esperti e, in caso di udienza in tribunale, gli sviluppatori potrebbero essere tenuti a fornire elenchi all’utente per ordine del tribunale.

Pertanto, fai sempre attenzione a ciò che ci racconti, soprattutto se riguarda la tua vita personale o professionale.

In precedenza, gli esperti avevano identificato il chatbot più preciso con un minimo di “allucinazioni”: il chatbot Grok, sviluppato dalla società Ílona Maska, ha mostrato inaspettatamente il livello più basso di allucinazioni, e ChatGPT e Gemini erano in fondo alla classifica.

UNIAN ha scritto che ChatGPT occupa oltre l’80% del mercato globale dei chatbot e il 92% in Ucraina. I super più vicini sono Perplexity e Microsoft Copilot. La loro quota è del 15% di tutti gli utenti.